用单摄像头去实现虚化拍照并不是什么新鲜事,之前的 iPhone XR 以及更早的 Google Pixel 2 都有过类似的尝试。

苹果新推出的 iPhone SE 也是如此,但它的摄像头元件过于老旧,主要功劳还是在算法上。

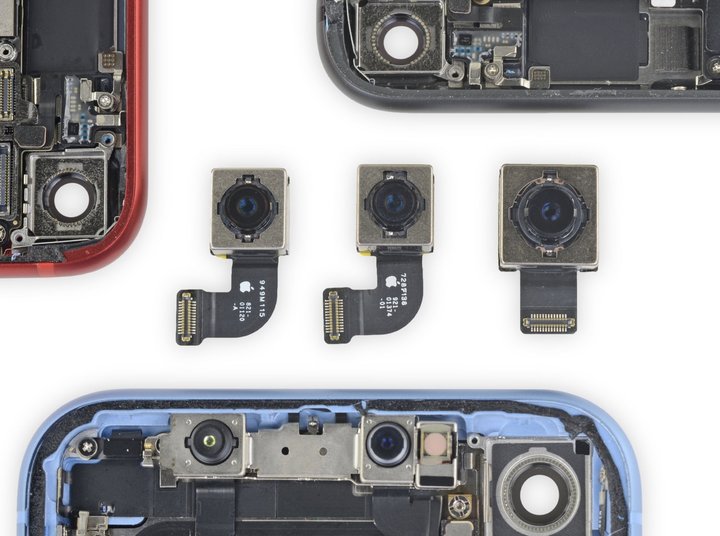

▲ 从左到右,分别是新 iPhone SE、iPhone 8 和 iPhone XR 的摄像头传感器

从 iFixit 的拆解报告可以得知,新款 iPhone SE 中的某些零部件和 iPhone 8 是完全一致的,甚至达到了可以互换使用的程度——其中就包括了那颗 1200 万像素的广角摄像头。

‘旧瓶装新酒’的做法对 iPhone SE 而言并不稀奇,倒退回四年前,第一代 iPhone SE 也套用了 5s 的外观和大部分硬件,所以苹果才能给出更低的价格。

理论上,照搬相同的摄像头硬件,两者的拍照特性应该也不会有太大差异。比如说 iPhone 8 就不支持拍主体清晰、背景模糊的小景深照片,也就是我们常说的‘人像模式’。

但查阅苹果的支持页面时你会发现,iPhone 8 所不支持的人像模式,却被新款 iPhone SE 支持了——哪怕两者的后置镜头规格是完全一样的。

在正常情况下,手机拍虚化照片往往需要靠双摄来完成——这就和人类的双眼一样,手机也要通过两个位置不同的镜头,来获取两张不同角度的画面,然后结合视角差估算出景深,从而实现背景虚化,保持主体清晰。

如今列表上的 Plus 系列,或是近几年的 X、 XS 和 11 等,基本都是靠多摄系统来完成人像虚化拍摄。

那么 iPhone 的前置单摄又是怎么解决的?核心在于 Face ID 系统中的红外点阵投影器,同样可以获取到足够精准的深度数据,相当于是一颗‘辅助镜头’。

这么来看,iPhone SE 能拍人像模式照片就很特殊了:一来它没有多摄,二来它也没有 Face ID,基本不存在硬件支持的可能性。

很显然,苹果在软件层面做了些我们看不到的改动。

最近,第三方相机应用 Halide 的开发者 Ben Sandofsky 就透露了其中的技术原理,解释为什么新 iPhone SE 采用了和 iPhone 8 一样的单镜头规格,但却可以做到后者所无法实现的人像拍照模式。

他们表示,新 iPhone SE 很可能是‘第一款只使用单一的 2D 图像,就可以生成人像虚化效果的 iPhone’。

你可能会说,iPhone XR 不也是单摄拍虚化的吗,SE 照搬它的方案不就好了?

然而拆解的情况已经证明, iPhone SE 和 iPhone XR 的摄像头并不一致,这也导致了两者在技术实现上存在差异。

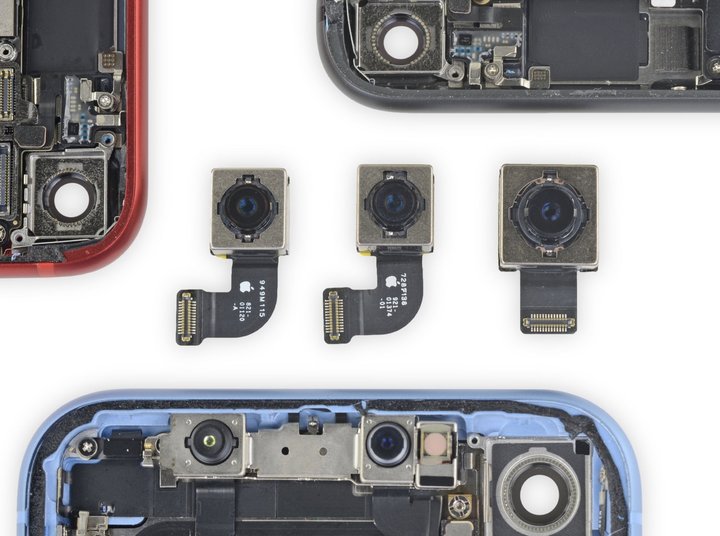

▲ 三星 Galaxy S7 系列是首个将 DPAF 技术运用在智能手机摄像头上的设备

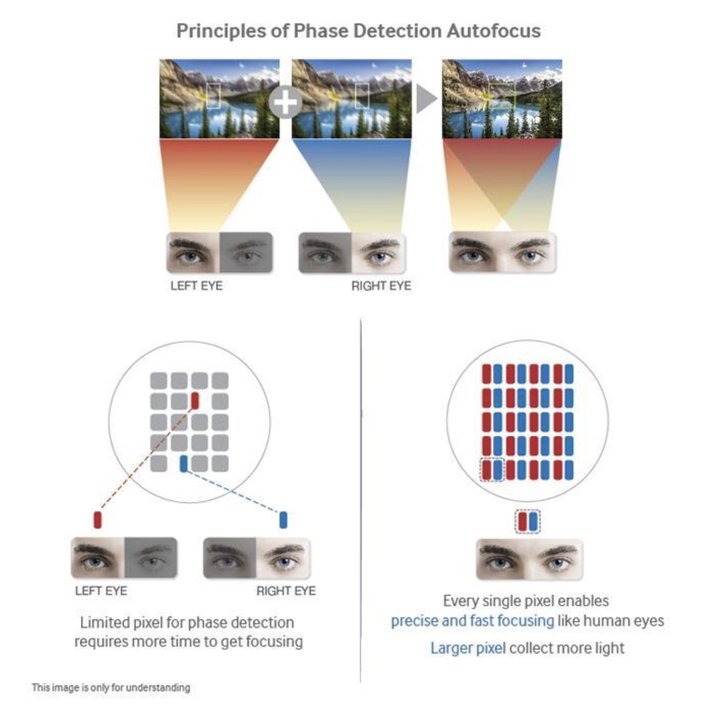

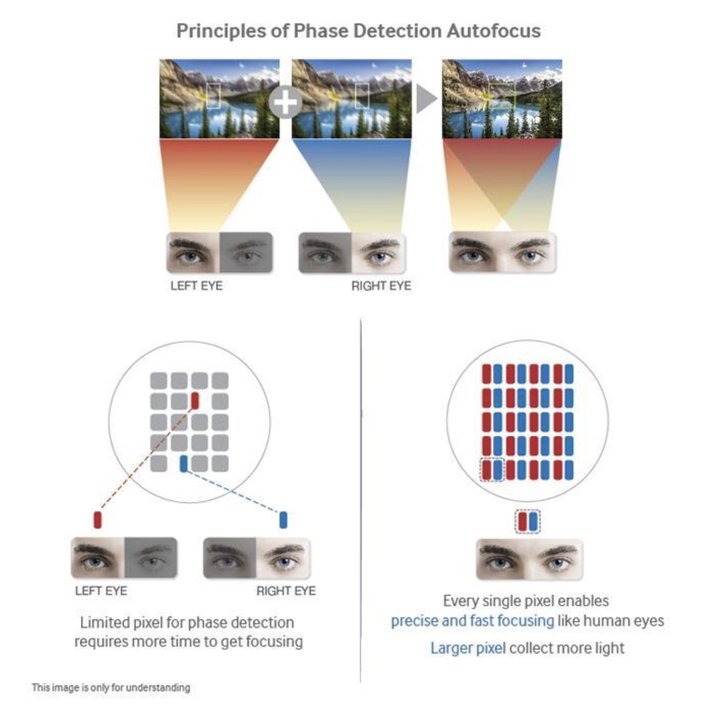

最重要的一点,iPhone XR 的摄像头可以使用双像素自动对焦(DPAF)技术,这让它能基于硬件获得一定的深度数据。

简单来说,DPAF 技术相当于将摄像头传感器上的像素点,分割成两个更小的并排像素,去捕捉两张角度不同的照片,就像是我们的左右双眼一样。

虽然这产生的视角差不如双摄那么明显,但仍有利于算法去生成深度数据。

▲ Google Pixel 2、3 使用 DPAF 技术获得的两张视差图,肉眼难以感知,但仍可以帮助图像分割算法做出判断

此前,Google 在 Pixel 2、3 上也运用了这样的技术来实现单摄虚化。而在 Pixel 4 上,由于该机换成了多摄规格,视差探测明显比单摄更精准。

▲ 再来看看 Pixel 4 靠两颗摄像头获得的数据,视差更明显,也能收集到更精准的数据

至于新 iPhone SE,由于它的传感器过于老旧,Halide 称它无法依靠传感器来获取视差图,基本只能靠 A13 Bionic 芯片所提供的机器学习算法,去模拟和生成深度数据图。

一句话解释就是,iPhone SE 的人像虚化拍摄,完全是靠软件和算法来实现的。

▲用 iPhone XR 和新 iPhone SE 直接对着这张照片拍摄

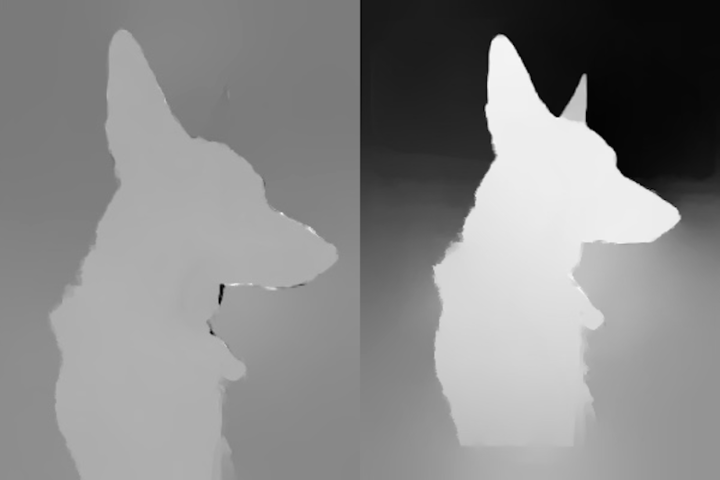

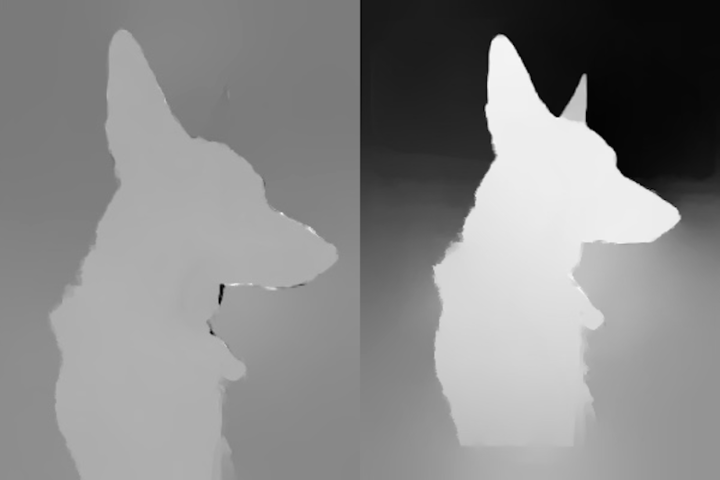

Halide 用 iPhone XR 和新 iPhone SE 分别拍摄了一张小狗的照片(并非实拍,只是给‘一张照片’拍照),然后对比两张图的深度数据。

他们发现,iPhone XR 仅仅是做了简单的图像分割,将主体抠了出来,但并没有正确识别出小狗的耳朵。

▲ 深度数据图,左边是 iPhone XR,右边是新 iPhone SE

但在新 iPhone SE 上,配合 A13 芯片所提供的全新算法,我们则得到了一张完全不同于 XR 的深度图。它不仅正确识别出了小狗的耳朵和整体轮廓,还针对不同远近的背景做了分层处理。

这种深度图并不是 100% 准确的,Halide 表示,新 iPhone SE 在拍摄非人脸题材的虚化照片时,抠图和虚化的精准度明显没有拍人像时来得精准。

尤其是在一些主体和背景图十分模糊的情况下,此时多摄像头的优势会更明显些。

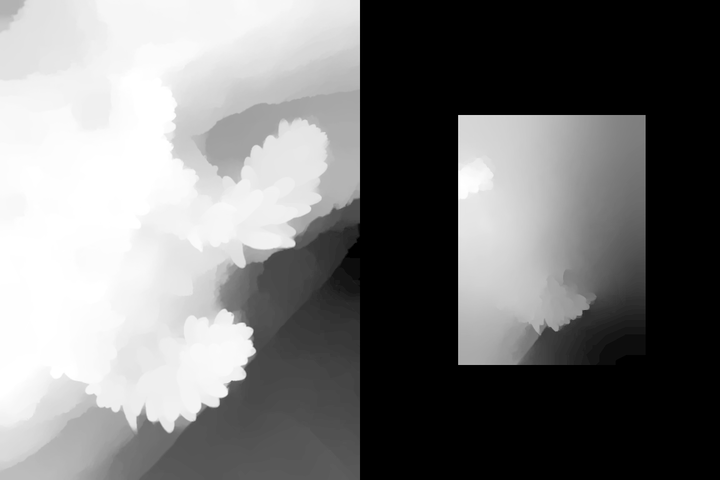

▲ 在这类非人脸题材,且主体和背景没有明显分割的场景下,新 iPhone SE 的虚化就很容易出错

从这张图可以看到,配备了多摄系统的 iPhone 11 Pro,不仅能将圆木上小植物轮廓完整地勾出来,而且还能对识别出背景的远近距离,并做出分层处理。

▲ 深度数据图,左边是 iPhone 11 Pro,右边是新 iPhone SE

而在新 iPhone SE 上,尽管同样有分层处理的结果,但被摄主体和背景已经完全融在了一起,做后期虚化处理时自然会比 iPhone 11 Pro 差不少。

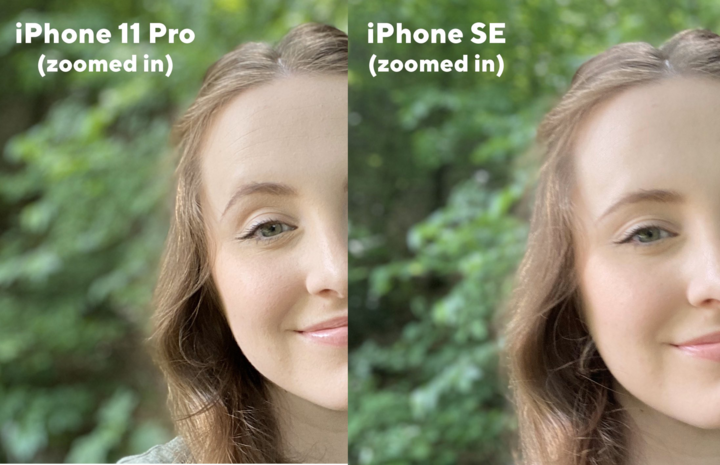

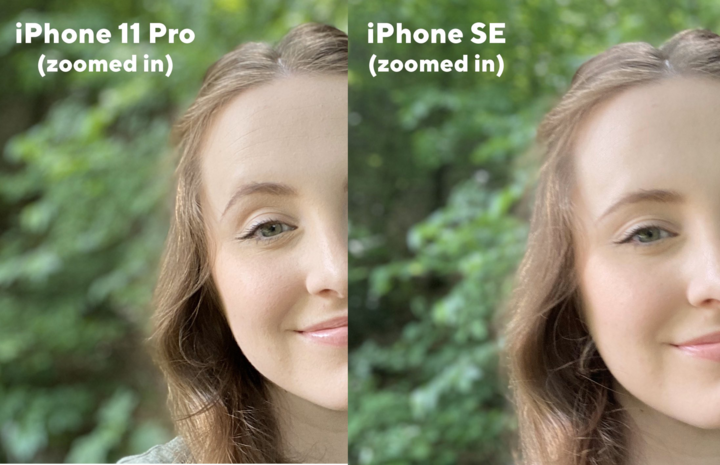

▲ 实际的虚化样张,左边是 iPhone 11 Pro,右边是新 iPhone SE

这也是为什么,当新 iPhone SE 使用 iOS 自带相机应用时,只有在检测到人脸的情况下,才能启用‘人像模式’拍虚化照片,其余情况则会出现错误提示。

原因仍然和苹果的算法有关。Halide 提及了一个名为‘Portrait Effects Matte’(人像效果遮罩)的技术,主要用于在人像模式照片中寻找出精确的人物轮廓,包括边缘的发丝、眼镜框等细节,然后再将主体和背景进行分割。

但目前来看,这套基于机器学习的分割技术更多是为‘拍人’所准备的,它的确可以弥补 iPhone XR 、iPhone SE 这类单摄手机在视差数据上的不足,但如果拍摄对象从人物换成其它物体,算法也会出现判定错误。

至于像 iPhone 11 Pro 这类多摄手机,则可以直接通过摄像头硬件来获得视差数据,所以它们在使用自带相机时,也能将人像模式用在非人脸场景中。

▲ 新 iPhone SE 的前置镜头也支持人像模式,对人脸的抠图精度非常高,成像差异只是在散景效果上

当然,官方不支持的东西,第三方开发者还是可以拿来加以改造。如今 Halide 应用可以支持 iPhone XR、SE 拍摄小动物或其它物体的虚化照片,其实也是利用了苹果的人像效果遮罩技术来获得深度图,再加入自己的后端优化来实现。

▲ 使用 Halide 这样的第三方应用,就可以用新 iPhone SE 拍非人脸题材的虚化照片

总得来看,本次新 iPhone SE 所实现的人像虚化拍照,算是单摄手机靠软件优化所能做到的极限了。严格意义上,这其实也得归功于那颗 A13 芯片,如果不是它带来了最新的机器学习算法,单靠摄像头本身,SE 的拍摄体验显然得打个对折。

所以, 智能手机发展多摄系统仍然是有意义的,我们可以用超广角来拓宽取景视野,可以靠长焦头来获得无损变焦照片,更别说 ToF、激光雷达这类‘特殊镜头’对 AR 增强现实的探测帮助,这些都不是单纯靠一个 OTA 升级,或是算法的打磨就能实现的。

当然,一味地吹嘘、比拼摄像头数量同样令人厌烦,如果说硬件只是决定了成像的下限,那么一套优秀的算法,则可以显著拉升成像的上限,甚至是重新压榨出老硬件的价值和潜力。

不知道再等个四年,下一代 iPhone SE 面世时,单摄还能否在手机行业留有一席之地?

题图来源:Apple